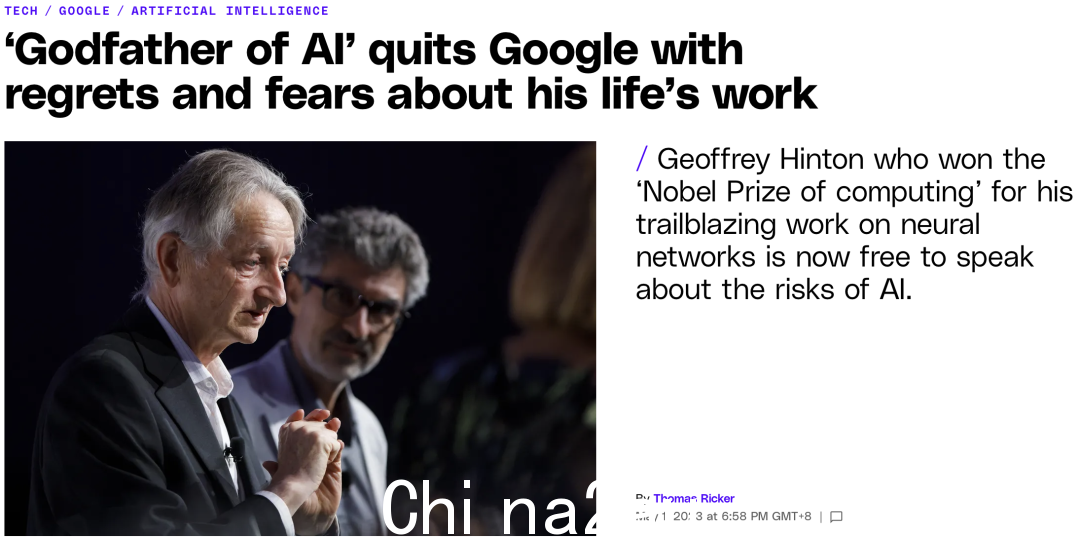

在谷歌工作 10 年后,人工智能教父欣顿选择了离开。对于造就了当今AI技术繁荣的神经网络,Hinton表示:这是我终生的遗憾。

一觉醒来,整个科技圈都震惊了! ! !

深度学习大师、神经网络之父Geoffrey Hinton突然宣布离开谷歌。

为了能够畅所欲言,不考虑人工智能的风险对谷歌的影响。

在《纽约时报》的报道中,欣顿直接警告世人:注意,前方有危险,前方有危险,前方有危险!

正是对人工智能风险的深切关注,让这家深度学习巨头直言:“我后悔一生的工作。”

如今,整整十年自从欣顿加入谷歌。

对于Hinton的举动,甚至有人劝说应该把注意力常态化到安全上人工智能而无需辞去工作。

这应该是你留下来的理由。因为世界不会停止,像你这样伟大的人应该坚持下去,让人工智能变得更好。

你应该说服你的学生 Yann LeCun 和 Ilya Sutskever。

值得一提的是,ChatGPT背后的真正功臣是OpenAI的联合创始人兼首席科学家Ilya。

AI“关键时刻” , 人类无法控制

Geoffrey Hinton,被誉为“人工智能教父”,始终是该领域最受尊敬的先驱之一。

今年3月底,万大佬联名联名信呼吁暂停六个月训练比 GPT-4 更强大的 AI。

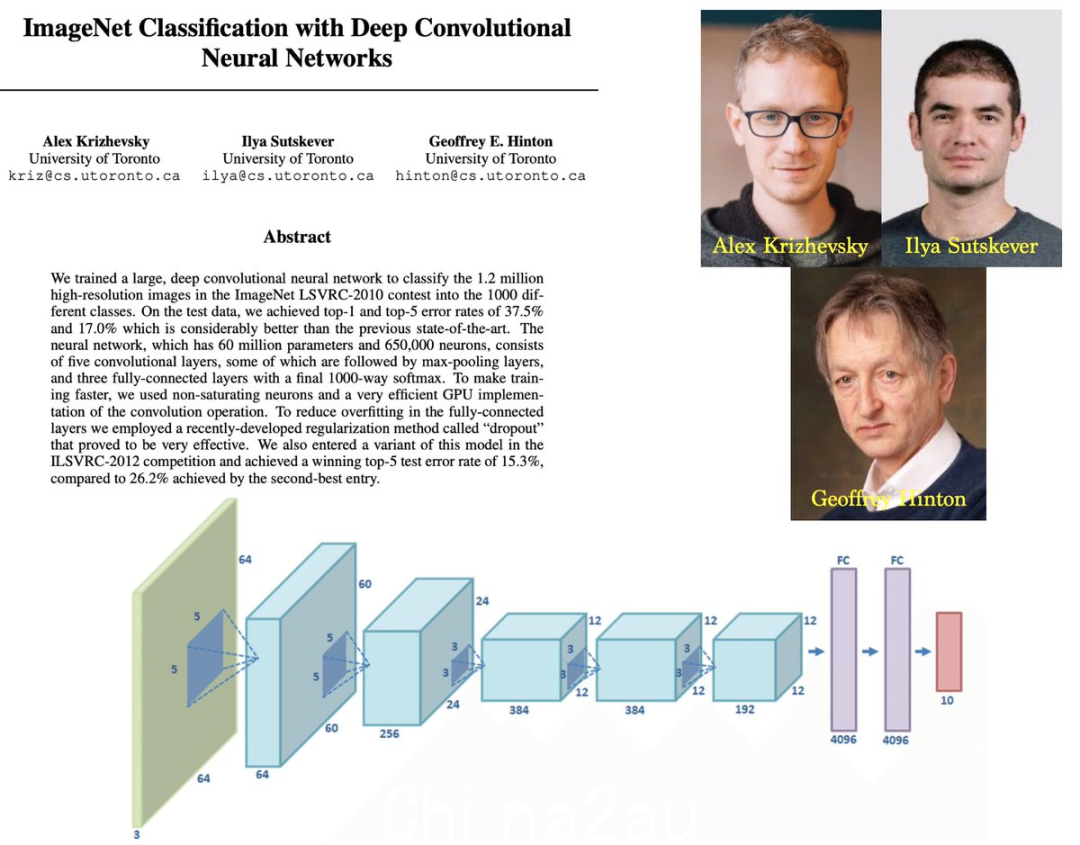

图灵三巨头中,本吉奥高调签名,LeCun毫不含糊地反对。只有欣顿一言不发,沉默得耐人寻味。

Hinton提出辞职的时间正好是在这之后的4月份。

从他的推特可以看出是否是因为最近GPT-4这样的超级AI,或者谷歌高层的剧烈动荡,Hinton始终保持沉默,一句话也没说。

很多人关心人工智能教父的态度。

在接受 CBS 采访时,Hinton 表示“我们几乎教会了计算机如何自我提升,这是危险的,我们必须认真考虑如何控制它。”

< img style="display: block; margin: 0 auto;" src="/uploads/allimg/230504/0943533245-9.jpg" />

来自手册 Hinton从智能先驱到末日先知的转变也标志着几十年来科技行业最重要的转折点。

先行者的沉痛反思,终于让我们再也无法掩耳盗铃,假装看不到人工智能可能给人类社会带来的深刻变化和巨大危机。

盖茨和许多其他大佬认为,ChatGPT 可能与 1990 年代初期的网络浏览器一样重要,并可能在药物研究和教育等领域带来突破。

与此同时,让不少业内人士感到不安的是,他们担心自己所做的研究正在向外界释放某种危险。

因为生成式人工智能可能已经成为产生错误信息的工具,并且在未来的某个时候,可能对人类构成威胁。

在 Hinton 看来,我们还没有找到一种方法来阻止坏人用它来做坏事。

在 3 月下旬一封呼吁暂停超人 AI 六个月的公开信几天后,人工智能促进协会的 19 位领导人也发表了一封公开信,警告 AI 的风险。

其中就有微软首席科学官Eric Horvitz,他已经在Bing搜索引擎等一系列产品中部署了Ope。nAI的GPT技术。

在一片叫嚣的反对声中,人工智能教父欣顿没有在这两封信上签字。

他表示,在辞去工作之前,他不想公开批评谷歌或其他公司。

经过上个月的忍耐,辛顿终于下定决心,通知谷歌他即将辞职。

在选择离开Google之后,Hinton终于可以畅所欲言AI的风险了。

我对我一生的工作深表遗憾。

我只能这样安慰自己:就算没有我,也会有别人。

周四,他与谷歌母公司首席执行官桑达尔·皮查伊通了电话Alphabet,但表示他无法透露谈话的细节。

作为一家大公司,谷歌对AI的态度一直很保守,甚至保守到眼睁睁看着自己在聊天AI机器人大战中落伍。

早在2015年,谷歌的图像识别AI就曾将黑人贴上“大猩猩”的标签,招致的非议让谷歌如履薄冰。

在OpenAI推出风靡全球的Dall-E 2之前,谷歌也有类似的模型,但没有发布,因为谷歌认为需要对AI生成的内容负责.

早在2021年,谷歌就已经有了类似ChatGPT的LaMDA聊天机器人,但谷歌一直没有发布。到 2022 年 11 月底,OpenAI 将凭借 ChatGPT 成为众人瞩目的焦点。

现在,谷歌首席科学家杰夫迪恩在一份声明中表示:“我们仍然致力于对人工智能采取负责任的态度,我们正在不断学习了解新出现的风险并大胆创新。”

打开历史,见证历史

打开历史,见证历史

1972年,Hinton开始他在爱丁堡大学攻读研究生。

在那里,他首先开始研究神经网络——一种通过分析数据来学习技能的数学系统。

当时,很少有研究人员相信这个观点。但这成了他一生的工作。

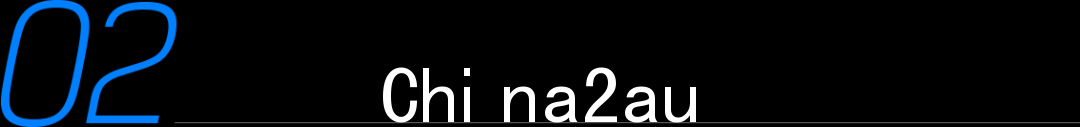

2012 年,Hinton 和他的两个学生, Ilya Sutskever 和 Alex Krishevsky 建立了一个神经网络,可以分析数千张照片并自学识别常见物体,如花、狗和汽车。

神经网络成为 DNNresearch 背后的突破性概念,DNNresearch 是他合作的公司-由两名学生创立,最终于 2013 年以 4400 万美元被 Valley 收购。

2018 年,Geoffrey Hinton、Yann LeCun 和 Yoshua Bengio 因其在神经网络和神经网络方面的研究而获得 2018 年图灵奖网络是 ChatGPT 和 Bard 等聊天机器人背后的基础技术。

Hinton 的学生 Ilya Sutskever 后来成为首席科学家OpenAI。

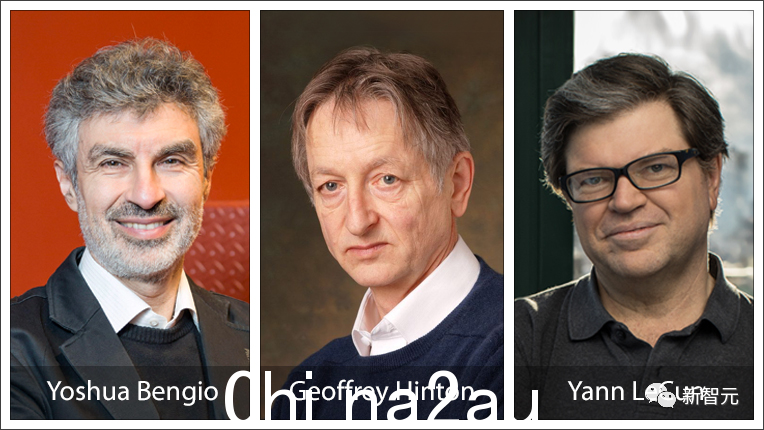

大约在同一时间,Google、OpenAI 和其他科技公司开始构建从大量数字文本中学习的神经网络。

当时,Hinton 认为这是机器理解和生成语言的强大方式。当然,我不得不承认与人类处理语言的方式相比,神经网络仍然超出了他们的能力范围。

2022 年,随着 Google 和 OpenAI 使用大量数据构建超级 AI。

Hinton 的观点已经发生了重大转变。他仍然认为,这些系统在某些方面不如人脑,但在其他方面正在超越人类智能。

在 GPT-4 发布的那天,Hinton曾经说过,毛毛虫吸收了养分后,会变成蝴蝶。而人类提取了数十亿的理解金块,GPT-4,就是人类的蝴蝶。

在Hinton的夸赞背后,很多人看到了超级人工智能系统的智能已经很不凡了。

对此,在谈到人工智能技术时,Hinton表示,随着科技公司完善人工智能系统,它们变得越来越危险。

看看五年前和现在的情况,如果继续传播这种技术,后果会很可怕!

在谷歌十年的职业生涯中,Hinton一直看好谷歌在人工智能技术上的谨慎态度。

他说,直到去年,谷歌一直担任该技术的“适当管家”,小心翼翼地不发布具有潜在危险的人工智能。

这恰好解释了谷歌为何在这波人工智能浪潮中落后。

但是现在,微软为其 Bing 搜索引擎插入 GPT-4 的能力让谷歌急切地不得不做点什么。

你好Nton 说,科技巨头正在进行一场可能无法停止的竞赛。

他最担心的是互联网将充斥着假照片、视频和文字,人们将无法分辨什么是真实的,什么是假的。

他甚至担心人工智能技术迟早会扰乱就业市场。

如今,像 ChatGPT 这样的聊天机器人往往可以很好地协助人类,甚至可以取代律师助理、私人助理、翻译和其他处理死记硬背任务的人。

未来,他表示非常担心GPT-4迭代会对人类构成威胁,强AI可以从大量数据中学习到意想不到的行为。

人工智能系统不仅可以生成代码,还可以运行代码本身。前段时间爆火的Auto-GPT就是一个很典型的例子。

他担心有一天真正的自主武器——那些杀手机器人——会成为现实。

80年代,Hinton是卡内基梅隆大学计算机系教授,但因为不愿意接受五角大楼的资助,他选择离开CMU前往加拿大。当时,Hinton 强烈反对在战场上使用 AI,他称之为“机器人士兵”。

在一些人看来,类似的系统其实比人类更聪明。 Hinton 表示,他曾经认为这太离谱了,至少需要 30-50 年,甚至更长的时间才能实现。

现在,我不这么认为了。

许多其他专家,包括 Hinton 的许多学生和同事,都表示这种威胁只是假设性的。

他指出,谷歌与微软以及其他公司之间的竞争,将升级为全球竞争。如果没有某种全球监管,这场比赛就不会停止!

但是他说这不是绝对的。与核武器不同,我们无法知道哪些公司或国家正在秘密研究这项技术。

网友热议:连Hinton都辞职了,下一个会是谁?

有网友认为Hinton对AI的看法过于悲观。

我看到 ChatGPT 的积极用途远多于消极用途,但现在的趋势是将 AI 描绘成邪恶的炼金术。这些担忧是有道理的,我们学习,我们纠正它,然后我们继续前进。

有些网友甚至把它比作天网,但我们关不掉然而。 “人工智能就像潘多拉魔盒,一旦打开就无法关闭。”

其他人质疑谷歌“负责”的观点:

< p>-用 Breitbart 模型训练 AI; - 让负面信息在 YouTube 上传播(反过来又为推荐算法提供信息); - 传播有关安全和隐私的科学虚假信息; - 消防专家

谷歌大脑和DeepMind的合并,有关系吗?

也有网友提问,连Hinton都辞职了,下一个会是谁?

参考:http://www.nytimes.com/2023/05/ 01/technology/ai-google-chatbot-engineer-quits-hinton.html

本文不构成个人投资建议,不代表本平台观点。市场有风险,投资需谨慎。请您独立作出判断和决定。

澳洲中文论坛热点

- 悉尼部份城铁将封闭一年,华人区受影响!只能乘巴士(组图)

- 据《逐日电讯报》报导,从明年年中开始,因为从Bankstown和Sydenham的城铁将因Metro South West革新名目而

- 联邦政客们具有多少房产?

- 据本月早些时分报导,绿党副首领、参议员Mehreen Faruqi已获准在Port Macquarie联系其房产并建造三栋投资联